KI-generierte Videos schwer von echten zu unterscheiden

Sicherheitslücke bei OpenAIs Sora 2: Wasserzeichen leicht entfernbar

Kurz nach dem Start von OpenAIs Video-KI Sora 2 sollen erste Tools das eingebettete Wasserzeichen in Sekundenschnelle entfernen können. Experten sehen die Authentizität digitaler Inhalte in Gefahr.

Laut Berichten mehrerer Medienplattformen sollen wenige Tage nach dem Start von Sora 2 bereits Online-Dienste existieren, die das von OpenAI verwendete Wasserzeichen in Sekundenschnelle entfernen können. Dabei handelt es sich um ein Cartoon-artiges Wolkensymbol mit Augen, das jeden KI-generierten C...

Laut Berichten mehrerer Medienplattformen sollen wenige Tage nach dem Start von Sora 2 bereits Online-Dienste existieren, die das von OpenAI verwendete Wasserzeichen in Sekundenschnelle entfernen können. Dabei handelt es sich um ein Cartoon-artiges Wolkensymbol mit Augen, das jeden KI-generierten Clip kennzeichnen soll.

Sora 2 außerhalb der EU gestartet

Die neue Version des Video-Generators wurde am 30. September 2025 veröffentlicht – allerdings ausschließlich außerhalb der Europäischen Union. OpenAI gab an, an Maßnahmen zur Einschränkung bestimmter Nutzungsarten zu arbeiten. Dazu zählen sichtbare Markierungen und C2PA-Metadaten, die Informationen über Herkunft und Bearbeitung eines Inhalts enthalten sollen.

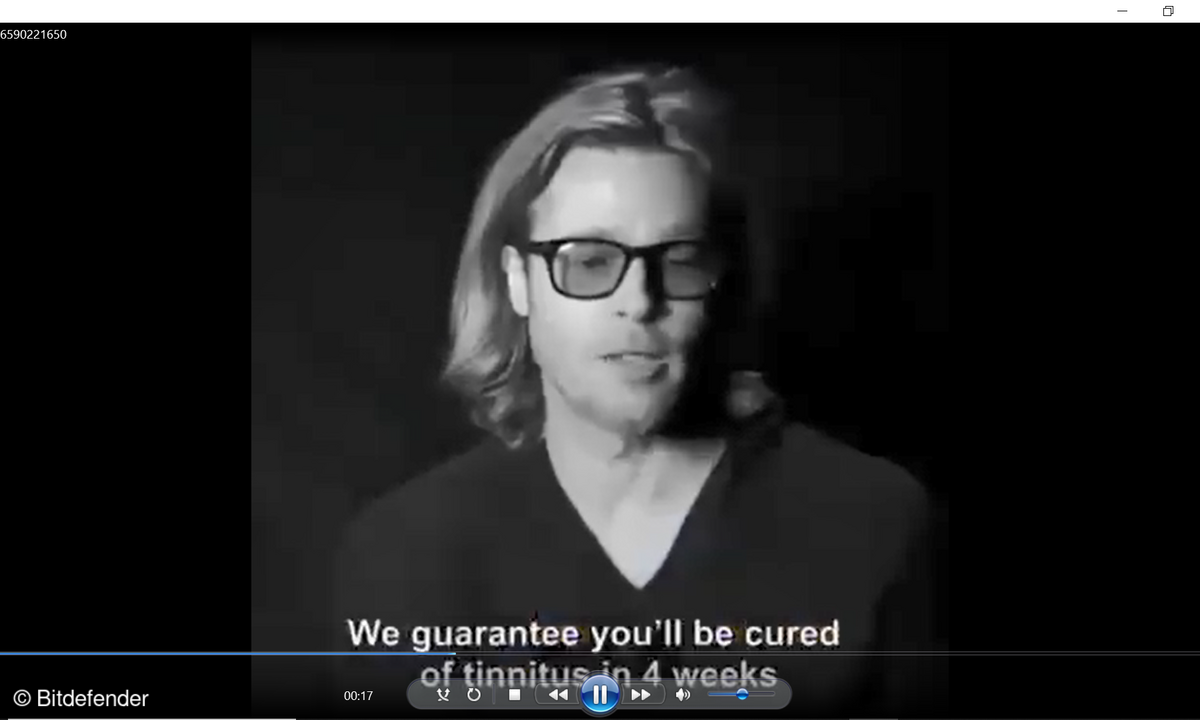

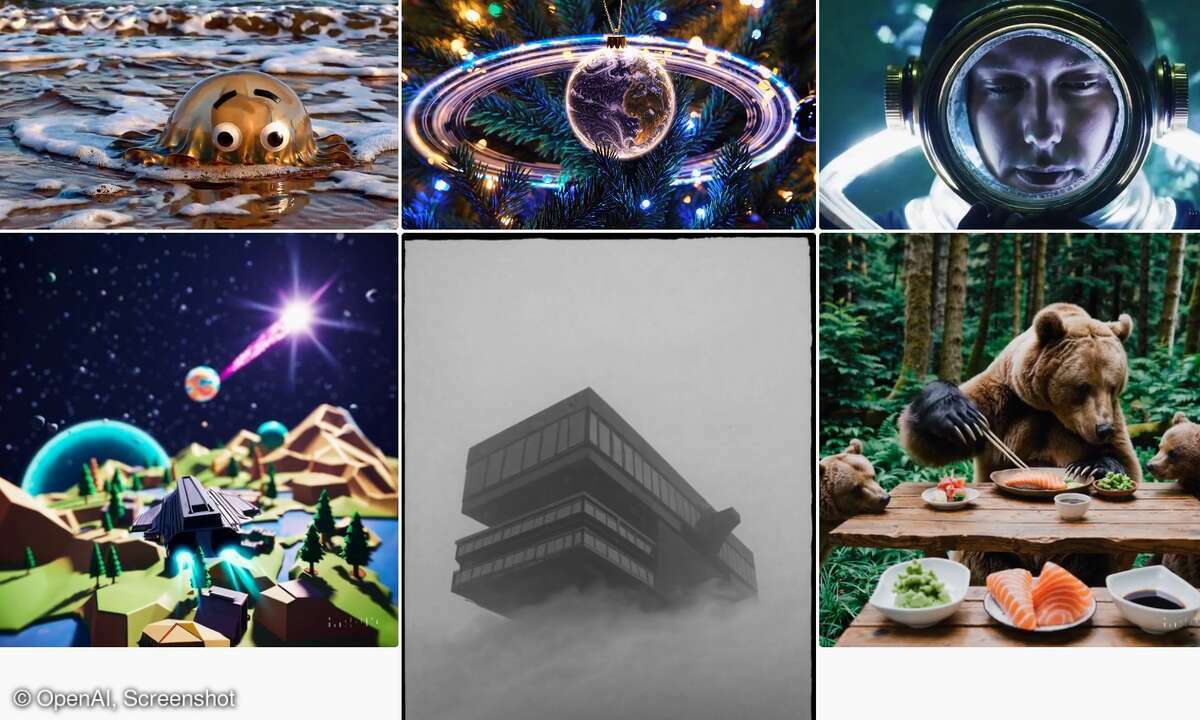

Täuschend echte Videos im Umlauf

Einige durch 404 Media analysierte Videos zeigen täuschend echte Szenen, wie etwa einen angeblichen Heiratsantrag in einer U-Bahn oder politische Ereignisse mit erfundenem Hintergrund. Zuschauer hielten diese Inhalte vielfach für real. Ein Wasserzeichen fehlte in diesen Fällen völlig, was auf einen erfolgreichen Entfernungsprozess hinweisen könnte.

Forderung nach enger Zusammenarbeit mit Plattformen

Experten fordern laut Medienberichten eine engere Kooperation zwischen KI-Entwicklern und sozialen Netzwerken. Plattformen müssten demnach in der Lage sein, sowohl eingebettete Kennzeichen zu erkennen als auch eine Verifizierung der Inhalte beim Hochladen vorzunehmen. Ziel sei es, die Authentizität digitaler Videos sicherzustellen.